Discussion lors d’un repas de famille, essayage d’une robe, toilettes, relations sexuelles… Travail devant votre ordinateur professionnel, utilisation de votre carte de crédit, vos codes bancaires et mots de passe… Vous pensez que cela fait partie de votre vie privée. Vous protégez ces moments et ces informations… ?

Ce n’est pas forcément le cas si vous ou quelqu’un d’autre porte des lunettes IA de Méta Ray-Ban.

Des données captées et analysées pour améliorer l’IA

Fin février les médias suédois Svenska Dagbladet et le Göteborgs-Posten ont publié une enquête sur les lunettes IA de Méta (Groupe de Facebook, Instagram, WhatsApp). Avec elles, de nombreuses données sont captées à l’insu des personnes et transférées sur des data centers.

Certaines formes d’apprentissage des intelligences artificielles (IA) nécessitent le travail de personnes humaines. Ainsi, chez un sous-traitant de Méta à Nairobi, au Kenya, les salariés ont pour mission d’examiner les images et d’étiqueter différents éléments : objets, animaux, visages, environnement. Ce travail d’annotation permet ensuite d’entraîner les algorithmes à mieux identifier les contenus et donc d’améliorer les systèmes d’intelligence artificielle.

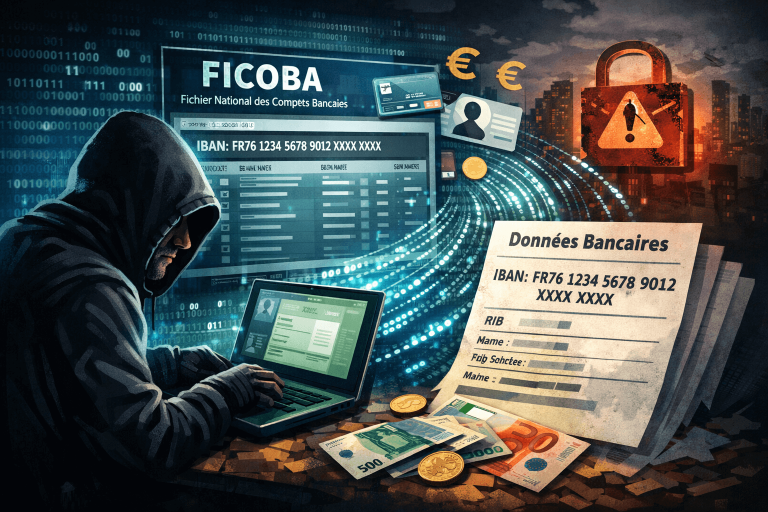

Interrogés par les journalistes suédois, des employés du sous-traitant affirment avoir eu accès à des clichés de personnes dans des situations intimes, avoir vu des cartes bancaires, etc.

Un accès nécessaire en cas de panne

C’est qu’au-delà de l’entrainement des IA, l’un des enjeux de l’IA physique ou l’IA connectée concerne le back office. Derrière les machines, des employés dans les bureaux interviennent pour améliorer la performance des produits ou les débloquer en cas de bug. C’est le cas par exemple lorsque les taxis autonomes se retrouvent bloqués dans une impasse ou pour des robots humanoïdes, installés au domicile de particuliers.

Dérives et protection des secrets industriels, commerciaux et de la vie privée

Parallèlement d’autres dérives apparaissent. Certains hommes cachent facilement les voyants vidéo et filment, à leur insu, des femmes qu’ils draguent dans la rue. Ces vidéos sont ensuite diffusées sur les réseaux sociaux, entraînant commentaires désobligeants et harcèlement pour ces dernières.

La question se pose également pour les secrets industriels ou commerciaux. Un employé disposant de lunettes connectées avec l’IA transfère ces données sur un serveur américain. Alors que l’Europe cherche à accroître sa souveraineté et son indépendance, ces lunettes peuvent poser question.

RGPD et plaintes

Ces révélations ont poussé plusieurs eurodéputés à saisir Bruxelles, afin de déterminer quelles mesures concrètes pourraient être prises à l’encontre de Meta. Le RGPD (Règlement général sur la protection des données) impose en effet que les personnes concernées soient informées de la collecte de leurs données et qu’elles donnent leur consentement explicite.

Le RGPD implique également que les données transférées vers un pays tiers, le soit vers un Etat avec un niveau de protection jugé « adéquat ». Or le Kenya, où sont analysées les images, est toujours en pourparlers avec Bruxelles.

Aux Etats Unis, l’affaire a également donné lieu à 2 plaintes, pour la violation des lois sur la protection de la vie privée et pour publicité mensongère.

Meta de son côté se défend et affirme prendre la protection de la vie privée au sérieux.

Sources :

- « On voit aussi des scènes de sexe filmées » : quand les sous-traitants des lunettes Meta à Nairobi voient tout, vraiment tout (Lemonde – Mars 2026)

- Sexe, nudité et coordonnées bancaires : derrière les nouvelles lunettes Meta, des employés mal à l’aise d’accéder à des vidéos privées (Libération – mars 2026)

- Des lunettes Meta dopées à l’IA auraient enregistré des scènes intimes à l’insu des utilisateurs (20 minutes – mars 2026).